CẢI THIỆN SỨC MẠNH CHO MẠNG NƠ-RON NHỊ PHÂN SỬ DỤNG PHƯƠNG PHÁP EFAT

559 lượt xemDOI:

https://doi.org/10.54939/1859-1043.j.mst.CSCE5.2021.14-23Từ khóa:

Mạng nơ-ron nhị phân; Tấn công đối nghịch; Phòng thủ đối nghịch; Huấn luyện đối nghịch nhanh.Tóm tắt

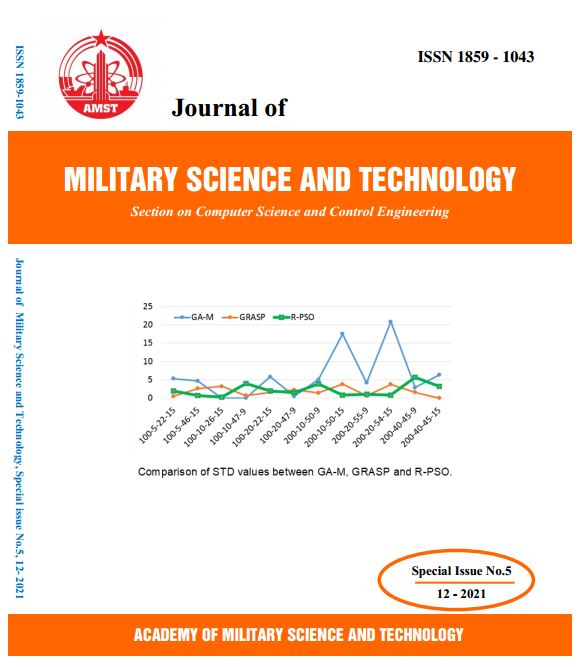

Trong những năm gần đây với sự bùng nổ các nghiên cứu về trí tuệ nhân tạo, mô hình học sâu dựa trên mạng nơ-ron tích chập (CNN) là một trong những kiến trúc hứa hẹn cho ứng dụng thực tế nhờ vào độ chính xác cao. Tuy nhiên, mạng CNN đặc trưng bởi các lớp tích chập thường có số lượng tham số và yêu cầu tính toán lớn dẫn đến tiêu tốn năng lượng khi huấn luyện cũng như thực thi dự đoán. Để khắc phục nhược điểm đó, mô hình mạng nơ-ron nhị phân (BNN) được đề xuất. BNN biểu diễn nhị phân cho giá trị đầu vào và tham số của các lớp trong mạng giúp giảm yêu cầu về bộ nhớ và đơn giản hóa các phép tính toán trong khi duy trì được độ chính xác chấp nhận được. Do đó, BNN rất phù hợp để triển khai ứng dụng Edge-AI trên các thiết bị hạn chế về tài nguyên và năng lượng như thiết bị nhúng hoặc thiết bị di động. CNN và BNN đều thực thi các lớp biến đổi tuyến tính, vì vậy chúng đều dễ dàng bị đánh lừa bởi các mẫu đối nghịch. Trong công trình này, chúng tôi xem xét tác động của tấn công đối nghịch (Adversarial attack) với BNN và đề xuất giải pháp nâng cao độ chính xác của BNN trước các loại tấn công này. Cụ thể, chúng tôi sử dụng phương pháp huấn luyện đối nghịch nhanh cải tiến (Enhanced Fast Aversarial Training - EFAT) để huấn luyện cho mạng. Sử dụng phương pháp này giúp mạng BNN chống lại được các tấn công mạnh với thời gian huấn luyện ngắn. Kết quả thực nghiệm với tấn công Fast Gradient Sign Method (FGSM) và Projected Gradient Descent (PGD) trên mạng BNN với tập dữ liệu MNIST tăng độ chính xác từ 31.34% và 0.18% lên 96.96% và 85.08%.

Tài liệu tham khảo

[1]. Mohammad Rastegari, Vicente Ordonez, Joseph Redmon, and Ali Farhadi. “XNOR-Net: ImageNet Classification Using Binary Convolutional Neural Networks.” ECCV (2016).

[2]. Matthieu Courbariaux, Itay Hubara, Daniel Soudry, Ran El-Yaniv and Yoshua Bengio. “Binarized Neural Networks: Training Deep Neural Networks with Weights and Activations Constrained to +1 or -1.” arXiv: Learning (2016).

[3]. Mohammad Rastegari, Vicente Ordonez, Joseph Redmon, and Ali Farhadi. “Enabling AI at the edge with XNOR-networks”. Communications of the ACM (2020), Vol.63, pp. 83-90.

[4]. Christian Szegedy, Wojciech Zaremba, Ilya Sutskever, Joan Bruna, Dumitru Erhan, Ian Goodfellow, and Rob Fergus. "Intriguing properties of neural networks." arXiv preprint arXiv:1312.6199 (2013).

[5]. Alexey Kurakin, Ian Goodfellow, and Samy Bengio. "Adversarial examples in the physical world." (2016).

[6]. Ian Goodfellow, Jonathon Shlens, and Christian Szegedy. "Explaining and harnessing adversarial examples." arXiv preprint arXiv:1412.6572 (2014).

[7]. Aleksander Madry, Aleksandar Makelov, Ludwig Schmidt, Dimitris Tsipras, and Adrian Vladu. "Towards deep learning models resistant to adversarial attacks." arXiv preprint arXiv:1706.06083 (2017).

[8]. Ali Shafahi, Mahyar Najibi, Amin Ghiasi, Zheng Xu, John Dickerson, Christoph Studer, Larry S. Davis, Gavin Taylor, and Tom Goldstein. "Adversarial training for free!." arXiv preprint arXiv:1904.12843 (2019).

[9]. Eric Wong, Leslie Rice, and J. Zico Kolter. "Fast is better than free: Revisiting adversarial training." arXiv preprint arXiv:2001.03994 (2020).

[10]. Angus Galloway, Graham W. Taylor, and Medhat Moussa. "Attacking binarized neural networks." arXiv preprint arXiv:1711.00449 (2017).

[11]. Manoj Rohit Vemparala, Alexander Frickenstein, Nael Fasfous, Lukas Frickenstein, Qi Zhao, Sabine Kuhn, Daniel Ehrhardt et al. "BreakingBED--Breaking Binary and Efficient Deep Neural Networks by Adversarial Attacks." arXiv preprint arXiv:2103.08031 (2021).

[12]. Lukas Geiger. “Binarized Neural Networks on microcontrollers.” tinyML Talks (2021).